降AI工具行业里有一个普遍现象:工具越来越多,但用户经常遇到「降了AI率,文章读起来不像自己写的了」的问题——逻辑断裂、措辞生硬、核心观点在改写后变模糊。

率零(www.0ailv.com)的DeepHelix引擎在设计时就是为了解决这个问题。它的核心策略可以用两句话概括:降AI不改意,降重不改魂。

「降AI不改意」是什么意思?

「改意」是指:处理完成后,文章的核心观点、论证逻辑、关键数据不在了,或者变了。这是用户最不能接受的结果。

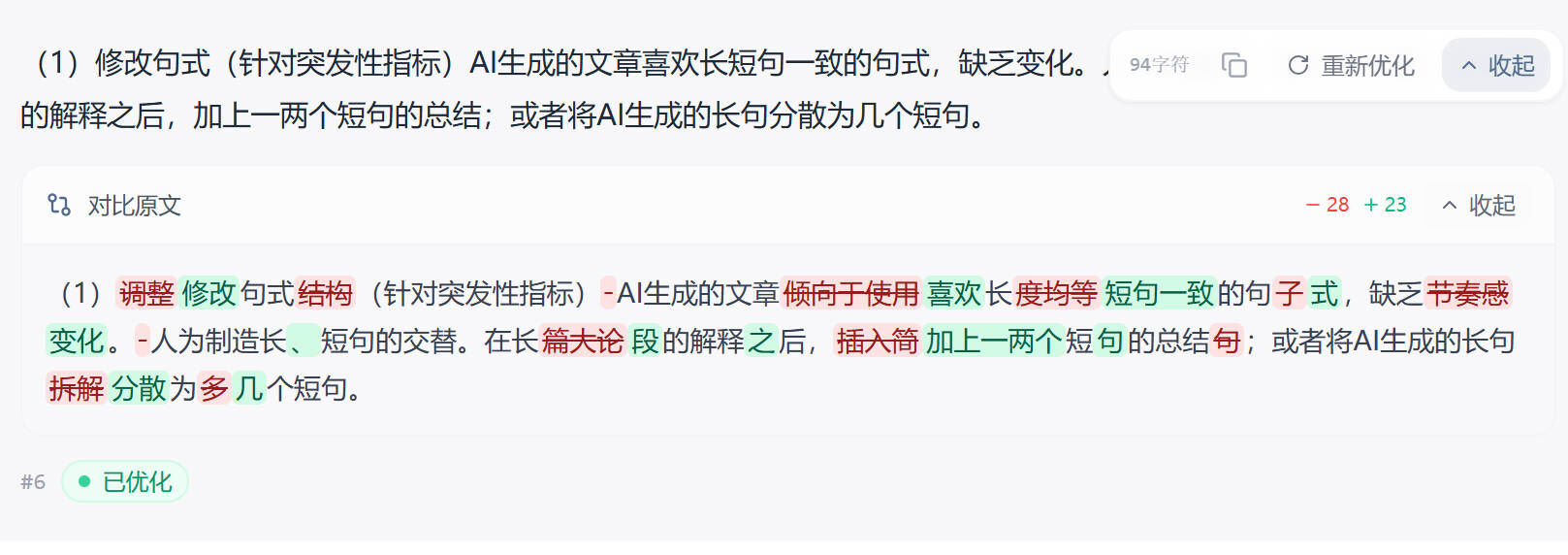

DeepHelix不在词汇层面做替换,而是在句式结构层面做深度重构。具体来说:

保留什么:论点、数据、结论、引用、论证关系(因果、递进、转折)

改变什么:句式节奏、信息密度分布、句子长度变化规律、段落内部的信息呈现顺序

这两类改变,对应的是AIGC检测器实际检测的维度。AI生成的文本在统计特征上有规律可循——困惑度低(用词意料之中)、突发性低(句式整齐划一)、信息密度均匀分布(每句都一样「充实」)。DeepHelix改的就是这些统计特征,而不是词汇本身。

结果:内容没变,但文本的统计生成模式从「AI模式」变成了「人类写作模式」。AIGC检测器看过去,不再识别为AI生成。

「降重不改魂」又是什么意思?

「降重不改魂」是一个额外发现,不是DeepHelix的设计目标。

很多使用率零的同学反映:处理完AI率,顺带把查重率也降了一些。这是真实发生的,背后有一个简单的逻辑:

DeepHelix在重构句式结构时,文本和之前的措辞组合有了实质性差异。查重系统(知网等)通过词汇和句子相似度与已发表文献比对——你的句子结构变了,和数据库里的文献的词汇组合差距变大,查重系统判断相似度降低,查重率下降。

「不改魂」的意思是:深度重构不是乱写,是在保持文章核心论证骨架(「魂」)的前提下调整表达形式。文章还是你那篇文章,只是在词汇和句式层面和已发表文献的差距更大了。

这个副效应对同时有查重和AI率问题的同学来说是实质性的好处:用一个工具解决两个维度的问题。

DeepHelix不是「对抗性优化」

降AI工具行业里有一类做法:分析某个检测器的弱点,针对这些弱点设计处理策略,通过特定模式规避检测。

这类方式的问题是:检测器一旦更新算法,规避策略就失效了。2026年知网AIGC检测算法升级到v2.13后,很多2025年有效的降AI方式都失效了——这就是对抗性优化的脆弱性。

DeepHelix的方向不是这个。它的目标是:让文本本身的统计特征接近人类写作的自然模式,而不是针对某个检测器的弱点打补丁。

自然的人类写作有什么统计特征?困惑度高低起伏(有时用出乎意料的词,有时平铺直叙)、突发性真实(句子有长有短,有简单句有复合句)、信息密度不均匀(有铺垫有展开有收尾)。这些特征不依赖于某个检测器的算法,是文本本身的属性。

当文本达到这种自然状态,任何基于统计特征的AIGC检测器过来看,都不会识别为AI生成——不是因为绕过了检测,而是文本确实不再表现出AI生成的统计规律。

用户实际体验中的双效

使用率零的同学描述处理结果时,常见的反馈有两类:

关于AI率:「知网AIGC检测从78%降到了4%,处理后文章读起来还是我的逻辑,没有变成奇怪的样子。」

关于查重:「降完AI率,顺手又查了一次查重,率从17%降到了10%,我连降重工具都省了。」

第一类反馈是「不改意」的验证——效果达标但文章还是原来的文章。第二类反馈是「不改魂」的具体体现——深度重构句式结构,客观上把查重率也带下来了。

总结

降AI不改意:DeepHelix改写统计特征(句式节奏、信息密度分布),不改观点和论证——处理后文章还是你的文章,不是另一个版本。

降重不改魂:深度句式重构增大文本与已发表文献的词汇差异,查重率通常进一步下降——不是设计目标,但是客观结果,是DeepHelix深度重构的副产品。

不是对抗性优化:不针对某个检测器打补丁,而是让文本本身的统计特征接近人类写作自然模式——这个结果不依赖于特定检测器版本,更稳定。

工具直达:率零(www.0ailv.com)——DeepHelix引擎,1000字免费体验