很多同学遇到这样的困惑:用降重工具处理了论文,查重率确实下来了,但AI率纹丝不动,甚至还上去了。

这不是工具的bug,也不是玄学——是查重检测和AI率检测从根本上检测的是两件不同的事。

查重检测在检测什么?

查重系统(知网、万方、维普等)的工作原理本质上是文本相似度匹配。

核心逻辑:拿你的论文,和数据库里的已发表文献逐段比对,看词汇和句子是否重复或高度相似。

技术实现上,常见方式包括:

- n-gram匹配:将文本切分成固定长度的词组(如每3个词为一组),和数据库里的词组比对

- 句子级指纹:提取句子特征,和数据库里的句子特征比对相似度

- 语义相似度:更高级的系统会做语义层面的匹配,捕捉「换个说法表达同一意思」的情况

归根结底,查重回答的问题是:这段话,有没有出现在已发表的文献里?

AIGC检测在检测什么?

这是和查重完全不同的一套逻辑。

AIGC检测(知网AIGC检测v2.13、GPTZero等)不和数据库比对,它分析的是文本本身的统计特征,判断这段文字的生成模式是否符合AI的写作规律。

具体来说,AIGC检测会分析:

| 特征维度 | 含义 | AI文本的典型表现 |

|---|---|---|

| 困惑度(Perplexity) | 下一个词有多难预测 | AI文本困惑度低,用词「意料之中」 |

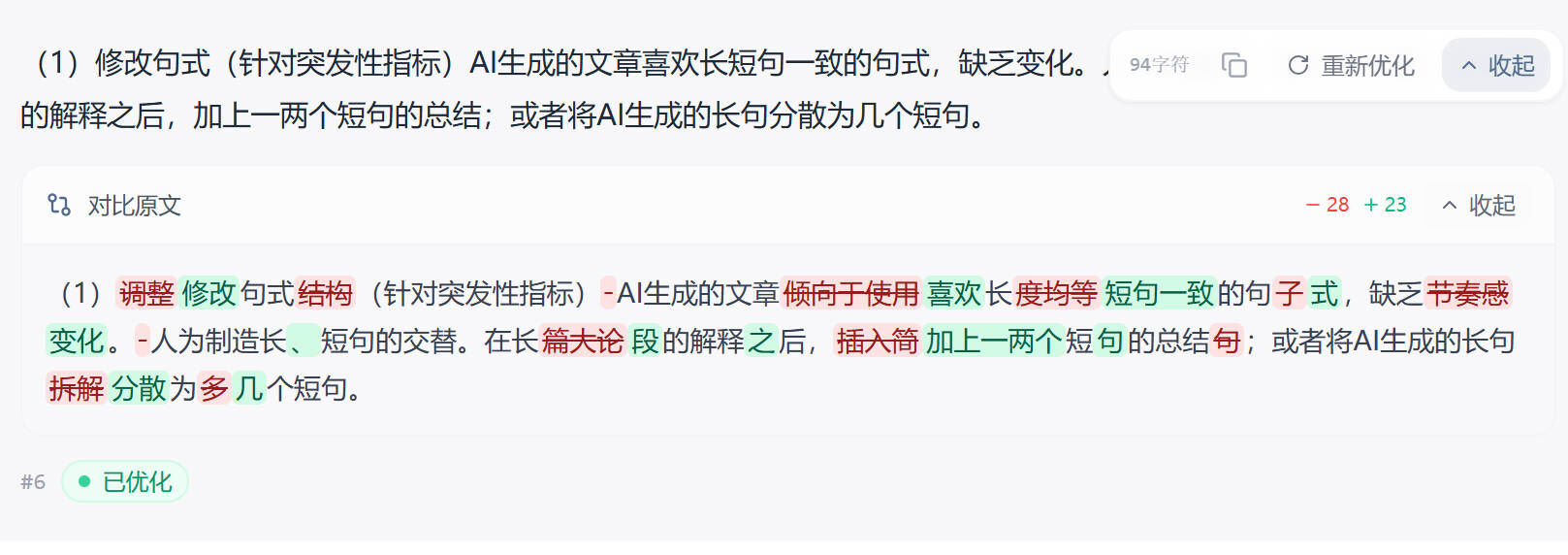

| 突发性(Burstiness) | 句子长度和复杂度的变化幅度 | AI文本句式整齐,变化幅度小 |

| 信息密度 | 每句话包含多少新信息 | AI文本每句都很「充实」,人类写作有高有低 |

| 句式结构规律性 | 段落逻辑是否遵循固定模式 | AI文本段落结构高度一致 |

回答的问题是:这段话,它的生成模式,像人写的还是像AI写的?

为什么降重工具改不了AI率?

理解了上面两点,答案就很清楚了。

降重工具做的事:同义词替换、句式微调、语序调整、段落重组。改变的是词汇层面的内容——让你的句子和数据库里的句子不再相同。

AI率检测看的东西:不是具体用了哪些词,而是文本整体的统计特征分布——困惑度、突发性、信息密度模式。

用降重工具做同义词替换,「提高」换成「增强」,「方法」换成「策略」——统计特征并没有变化。那段文字的困惑度模式、句式结构规律性,和替换之前几乎一样。AIGC检测器看过去,依然识别出同样的AI特征。

还有一种情况更糟:AI辅助降重工具(很多降重工具底层用AI改写)在帮你降重的过程中,本身就引入了新的AI写作特征。你先降AI率,再用这类工具降重,降重完成后AI率反而上升了——原来的AI痕迹没了,工具改写时带来了新的AI痕迹。

从检测原理看:降AI的正确方向是什么?

AIGC检测看的是统计特征,那正确的降AI方向就是在统计特征层面消除AI痕迹——而不是在词汇层面做替换。

这也是率零(www.0ailv.com)DeepHelix引擎的设计逻辑。

DeepHelix的工作方式:从句式结构层面深度重构文本,改变文本的信息密度分布、句式变化幅度和段落结构规律。处理完成后,文本的统计特征分布接近人类写作的自然波动模式,而非AI生成的整齐规律。

这个过程不是「对抗性优化」(针对某个特定检测器打补丁),而是让文本本身变得自然——自然到无论哪套检测逻辑来看,都不符合AI生成的统计模式。

DeepHelix的一个副产品:句式结构层面的深度重构,会同时增大文本与已发表文献的词汇差异,让查重系统判断相似度更低。这是很多使用率零的同学反映的「降AI后查重率也下来了」——不是设计目标,但是检测原理推导出来的客观结果。

两种检测的工具对应关系

| 问题 | 检测原理 | 正确工具 | 无效方案 |

|---|---|---|---|

| 查重超标 | 文本内容相似度 | 降重工具(同义词替换/改写) | AIGC降AI工具 |

| AI率超标 | 文本统计特征 | DeepHelix等统计特征层工具 | 降重工具 |

两件事,两套检测逻辑,两种处理工具。用错了,不是没效果,是做了无用功。

顺序建议

如果两个问题都有(查重超标 + AI率超标),推荐先降重,再降AI。

原因:

- 先降AI后降重:降重工具(特别是AI辅助降重)可能引入新AI特征,让AI率反弹

- 先降重后降AI:降重完成后文本定稿,再用DeepHelix处理统计特征,两件事互不干扰

- DeepHelix处理后,文本词汇差异增大,查重率通常进一步下降——不需要再额外降重

只有AI率超标、查重没问题的同学,直接用率零处理即可,不需要先跑降重。

总结

查重检测:文本和已发表文献的词汇相似度 → 降重工具解决

AIGC检测:文本的统计特征(困惑度/突发性/信息密度)→ DeepHelix等统计特征层工具解决

降重工具改词汇,不改统计特征 → 对AI率无效

DeepHelix改统计特征,顺带增大词汇差异 → 降AI同时降查重

工具直达:率零(www.0ailv.com)——DeepHelix引擎,统计特征层消除AI痕迹,1000字免费体验